-

BID contribuirá com até US$ 25 bi para aliança de Lula contra a fome

BID contribuirá com até US$ 25 bi para aliança de Lula contra a fome

-

Jogo entre Romênia e Kosovo é suspenso por cânticos de torcedores

-

Líbano analisa plano dos EUA para cessar-fogo entre Israel e Hezbollah

Líbano analisa plano dos EUA para cessar-fogo entre Israel e Hezbollah

-

Portugal avança às quartas da Liga das Nações com mais um recorde de CR7

-

Espanha vence Dinamarca e termina em 1º do grupo na Liga das Nações

Espanha vence Dinamarca e termina em 1º do grupo na Liga das Nações

-

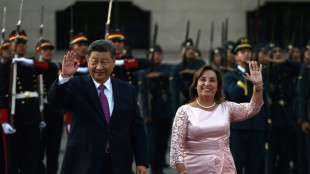

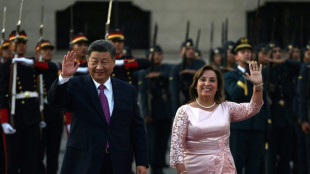

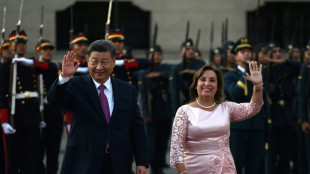

Na Apec, Biden e Xi alertam sobre "mudanças" e "turbulências" ante retorno de Trump

-

Zverev e Ruud avançam à semifinal do ATP Finals; Alcaraz é eliminado

Zverev e Ruud avançam à semifinal do ATP Finals; Alcaraz é eliminado

-

China estuda resistência de tijolos no espaço para construir base na Lua

-

Juventus anuncia rescisão de contrato com Pogba, suspenso por doping

Juventus anuncia rescisão de contrato com Pogba, suspenso por doping

-

Monumento aos heróis do levante do Gueto de Varsóvia é vandalizado na Polônia

-

Segurança de dados pessoais 'não é negociável', diz CEO do TikTok

Segurança de dados pessoais 'não é negociável', diz CEO do TikTok

-

Biden lidera abertura da cúpula da Apec em meio à expectativa pela nova era Trump

-

Comediante Conan O'Brien apresentará o próximo Oscar

Comediante Conan O'Brien apresentará o próximo Oscar

-

'Momentos difíceis': Noboa abre sessão final da Cúpula Ibero-Americana no Equador

-

Conmebol muda sede do Sul-Americano Sub-20 de 2025 do Peru para Venezuela

Conmebol muda sede do Sul-Americano Sub-20 de 2025 do Peru para Venezuela

-

Vini Jr. volta a decepcionar na Seleção, que não convence

-

Hamas afirma estar 'disposto' a uma trégua e pede para Trump 'presionar' Israel

Hamas afirma estar 'disposto' a uma trégua e pede para Trump 'presionar' Israel

-

Zverev avança à semifinal do ATP Finals; Alcaraz é eliminado

-

Dorival convoca Alex Telles e Dodô para jogo contra o Uruguai

Dorival convoca Alex Telles e Dodô para jogo contra o Uruguai

-

'IA não traz nenhum benefício para a sociedade', afirma ativista Sage Lenier

-

'IA não traz nenhum benefício para a socidade', afirma ativista Sage Lenier

'IA não traz nenhum benefício para a socidade', afirma ativista Sage Lenier

-

As diversas vozes da esquerda que tentam se fazer ouvir antes do G20 no Rio

-

Cúpula Íbero-Americana chega à sessão final sem a presença de líderes

Cúpula Íbero-Americana chega à sessão final sem a presença de líderes

-

EUA e China abrem cúpula da Apec em meio à expectativa pela nova era Trump

-

À espera de Trump, um G20 dividido busca o diálogo no Rio de Janeiro

À espera de Trump, um G20 dividido busca o diálogo no Rio de Janeiro

-

Partido do presidente de Sri Lanka conquista maioria absoluta nas legislativas

-

Milei chama vitória de Trump de 'maior retorno' da história

Milei chama vitória de Trump de 'maior retorno' da história

-

Executivos do petróleo marcam presença na COP29 e ONGs denunciam lobistas

-

Sul de Beirute é alvo de bombardeios após alerta do Exército israelense

Sul de Beirute é alvo de bombardeios após alerta do Exército israelense

-

Dominicano Juan Luis Guerra é o grande vencedor do Grammy Latino

-

Ataque russo deixa milhares sem calefação no sul da Ucrânia

Ataque russo deixa milhares sem calefação no sul da Ucrânia

-

Plata e Valencia brilham em goleada do Equador sobre a Bolívia (4-0) nas Eliminatórias

-

Paraguai surpreende e vence Argentina de virada (2-1) nas Eliminatórias

Paraguai surpreende e vence Argentina de virada (2-1) nas Eliminatórias

-

Biden e Xi chegam a Lima para reunião bilateral e cúpula da Apec

-

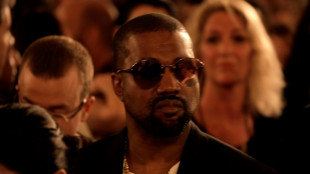

Kanye West disse que "judeus controlavam as Kardashians", segundo nova ação

Kanye West disse que "judeus controlavam as Kardashians", segundo nova ação

-

PF investiga ataque fracassado ao STF como 'ato terrorista'

-

Justiça boliviana reconhece nova direção de partido do governo sem Evo Morales

Justiça boliviana reconhece nova direção de partido do governo sem Evo Morales

-

Vini perde pênalti e Brasil empata com a Venezuela (1-1) nas Eliminatórias

-

Mortes por overdose de drogas ficam abaixo de 100 mil nos EUA

Mortes por overdose de drogas ficam abaixo de 100 mil nos EUA

-

França empata com Israel (0-0) em jogo quase sem público na Liga das Nações

-

Bombardeio contra centro da Defesa Civil deixa 12 mortos no Líbano

Bombardeio contra centro da Defesa Civil deixa 12 mortos no Líbano

-

Inglaterra vence Grécia (3-0) e fica perto do acesso na Liga das Nações

-

Itália vence Bélgica (1-0) e se garante nas quartas da Liga das Nações

Itália vence Bélgica (1-0) e se garante nas quartas da Liga das Nações

-

Sinner avança invicto à semifinal do ATP Finals; Fritz também se classifica

-

Irã diz que quer esclarecer 'dúvidas e ambiguidades' sobre programa nuclear

Irã diz que quer esclarecer 'dúvidas e ambiguidades' sobre programa nuclear

-

O que se sabe sobre a tentativa de ataque ao STF

-

Trump nomeia Robert F. Kennedy Jr. como secretário de Saúde

Trump nomeia Robert F. Kennedy Jr. como secretário de Saúde

-

Nova York instalará pedágio em Manhattan antes da posse de Trump

-

Morre opositor preso na Venezuela entre denúncias de "crise repressiva" após eleições

Morre opositor preso na Venezuela entre denúncias de "crise repressiva" após eleições

-

Métodos de guerra de Israel em Gaza têm 'características de genocídio', aponta comitê da ONU

A Inteligência Artificial pode acabar com a humanidade?

Os alarmes surgiram por todas as partes: a Inteligência Artificial (IA) representa um risco existencial para a humanidade e deve ser controlada antes que seja tarde demais.

Mas, quais são os cenários apocalípticos e como se supõe que as máquinas acabarão com a humanidade?

- Um "bom" problema -

A maioria dos cenários parte do mesmo ponto: um dia as máquinas ultrapassarão as capacidades humanas, ficarão fora de controle e se recusarão a ser desligadas.

"Uma vez que tenhamos máquinas que tenham como objetivo a autopreservação, teremos um bom problema", disse o especialista acadêmico em IA, Yoshua Bengio, durante uma conferência neste mês.

Mas como essas máquinas ainda não existem, imaginar como elas poderiam condenar a humanidade costuma ser tarefa da filosofia e da ficção científica.

O filósofo sueco Nick Bostrom mencionou uma "explosão de inteligência", que ocorrerá quando máquinas superinteligentes começarem a projetar outras máquinas.

As ideias de Bostrom foram descartadas por muitos como ficção científica, sobretudo porque ele argumentou uma vez que a humanidade é uma simulação de computador e apoiou teorias próximas à eugenia. Ele também se desculpou recentemente depois que uma mensagem racista que enviou na década de 1990 foi exposta.

No entanto, seus pensamentos sobre IA foram altamente influentes e inspiraram tanto Elon Musk quanto o professor Stephen Hawking.

- Exterminador do Futuro -

Se as máquinas superinteligentes vão destruir a humanidade, certamente precisarão de uma forma física.

O ciborgue de olhos vermelhos interpretado por Arnold Schwarzenegger em "Exterminador do Futuro" provou ser uma imagem impactante.

Mas os especialistas rejeitaram a ideia. "É pouco provável que esse conceito de ficção científica se torne realidade nas próximas décadas, se é que algum dia se tornarão", escreveu o Stop Killer Robots, um grupo ativista contra robôs de guerra, em um relatório de 2021.

No entanto, o grupo alertou que dar às máquinas o poder de tomar decisões sobre a vida e a morte é um risco existencial.

A especialista em robótica Kerstin Dautenhahn, da Universidade de Waterloo, no Canadá, minimizou esses temores.

É pouco provável, disse ela à AFP, que a IA forneça às máquinas maiores habilidades de raciocínio ou introduza nelas o "desejo" de matar todos os humanos.

"Os robôs não são ruins", afirmou, embora admita que os programadores podem obrigá-los a fazer coisas ruins.

- Substâncias químicas mais letais -

Um cenário menos fantasioso é o de "vilões" que usam IA para criar novos vírus e propagá-los.

Modelos de linguagem poderosos como o GPT-3, usado para criar o ChatGPT, são extremamente bons em inventar novos agentes químicos horríveis.

Um grupo de cientistas que usava IA para ajudar a descobrir novos medicamentos realizou um experimento no qual ajustou sua IA para que inventasse moléculas nocivas.

Eles conseguiram gerar 40.000 agentes potencialmente venenosos em menos de seis horas, de acordo com a revista Nature Machine Intelligence.

A especialista em Inteligência Artificial, Joanna Bryson, da Hertie School em Berlim, explicou que é perfeitamente possível que alguém descubra uma maneira de espalhar um veneno, como o antraz, de forma mais rápida.

"Mas não é uma ameaça existencial. É apenas uma arma horrível, assustadora", afirmou.

- Fase passageira -

As regras de Hollywood ditam que os desastres de época devem ser repentinos, enormes e dramáticos, mas e se o fim da humanidade fosse lento, silencioso e não definitivo?

"A nossa espécie pode chegar ao fim sem ter um sucessor", afirmou o filósofo Huw Price em um vídeo promocional do Centro de Estudos de Risco Existencial da Universidade de Cambridge.

Mas, em sua opinião, existem "possibilidades menos sombrias" nas quais os humanos aprimorados com tecnologia avançada poderiam sobreviver.

Uma imagem do apocalipse é muitas vezes enquadrada em termos evolutivos.

O conhecido físico teórico Stephen Hawking argumentou em 2014 que, em última instância, a nossa espécie não será mais capaz de competir com as máquinas de Inteligência Artificial. Ele disse à BBC que isso poderia "significar o fim da raça humana".

Geoffrey Hinton, que passou sua carreira construindo máquinas que se assemelham ao cérebro humano, fala em termos semelhantes de "superinteligências" que simplesmente vão superar os humanos.

Ele disse recentemente à emissora americana PBS que é possível que "a humanidade seja apenas uma fase passageira na evolução da inteligência".

T.Perez--AT